1,1K

Nell’apprendimento automatico, il modello della Memoria a Breve Termine Lunga (LSTM) è utilizzato principalmente nell’elaborazione di dati in sequenza.

Comprendere l’idea di base della memoria a breve termine (LSTM)

Oggi l’elaborazione di dati in sequenza è di grande importanza. Che si tratti di riconoscimento vocale, di analisi del testo o persino di previsione dei prezzi delle azioni, le sequenze costituiscono la base di molte cose. È qui che entra in gioco il modello Long Short-Term Memory (LSTM), un tipo speciale di rete neurale perfettamente adatto a questi compiti.

- A differenza delle reti neurali ricorrenti convenzionali (RNN), una LSTM è in grado di memorizzare informazioni per periodi di tempo più lunghi. Questo la rende particolarmente adatta a dati sequenziali in cui gli eventi passati sono importanti.

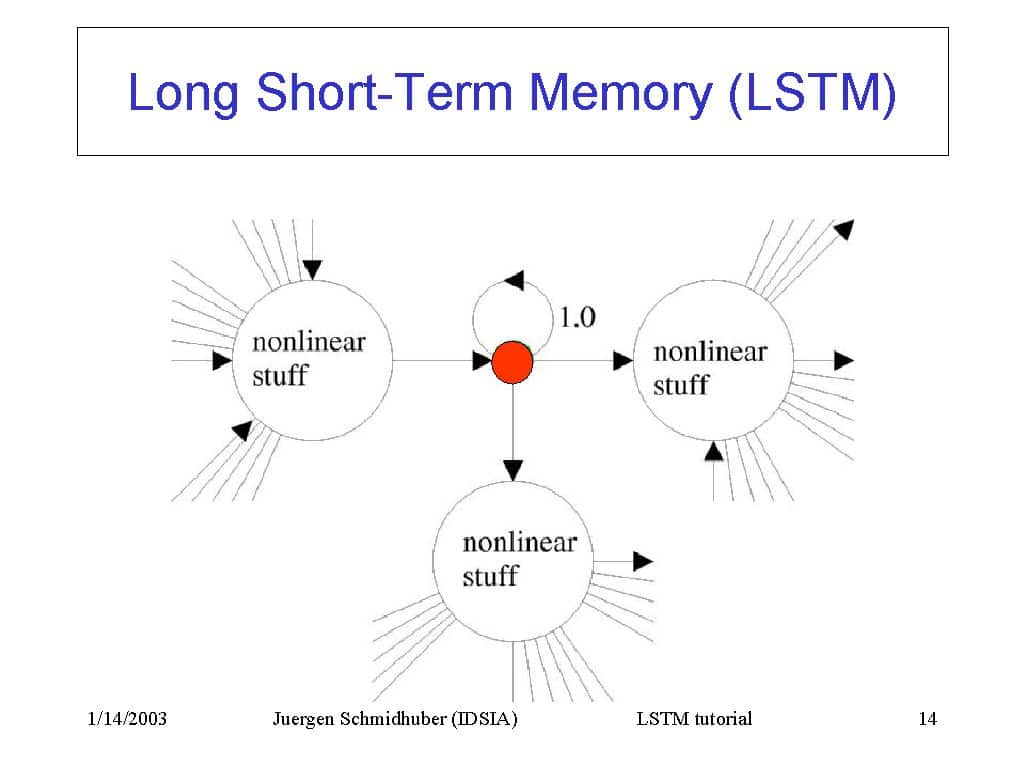

- Un modello LSTM è costituito da vari “cancelli” che regolano il flusso di informazioni. Questi cancelli determinano quando le informazioni vengono dimenticate, memorizzate o recuperate.

- Lo stato delle celle è il cuore di un LSTM. Agisce come una sorta di memoria, immagazzinando informazioni su lunghe sequenze.

- La porta di dimenticanza decide quali informazioni rimuovere dallo stato della cella. Utilizza la funzione sigmoide per determinare quali valori vengono scartati e quali rimangono in memoria.

- Questa funzione decide quali nuove informazioni sullo stato della cella devono essere aggiunte. Si compone di due parti: La funzione di attivazione sigmoide, che decide quali valori aggiornare, e la funzione tanh, che genera nuovi valori candidati.

Applicazione e vantaggi di LSTM

Le LSTM sono in grado di catturare le dipendenze a lungo termine nelle sequenze. Ciò conferisce loro un’ampia gamma di applicazioni.

- I modelli LSTM sono eccellenti per la previsione di sequenze, come i dati meteorologici o i prezzi delle azioni. Grazie alla loro memoria e alla capacità di utilizzare informazioni risalenti a molto tempo prima, gli LSTM possono cogliere relazioni complesse nei dati.

- In NLP, le LSTM sono spesso utilizzate per compiti quali la classificazione di testi, il riconoscimento di entità nominate e la traduzione automatica. Possono catturare meglio il contesto dei testi e quindi migliorare la qualità dei risultati.

- LSTM può essere utilizzato anche nel riconoscimento vocale per convertire le parole pronunciate in testo.

- La capacità di catturare le dipendenze a lungo termine rende le LSTM ideali per applicazioni in cui le relazioni temporali sono importanti, come la composizione musicale.