534

機械学習において、LSTM(Long Short-Term Memory)モデルは、主にシーケンスデータの処理に使用される。

長期短期記憶(LSTM)の基本的な考え方を理解する

今日、シーケンスデータの処理は非常に重要である。音声認識であれ、テキスト分析であれ、あるいは株価予測であれ、シーケンスは様々なものの基礎を形成している。そこで登場するのが、このようなタスクに最適な特殊なニューラルネットワークであるLSTM(Long Short-Term Memory)モデルだ。

- 従来のリカレントニューラルネットワーク(RNN)とは異なり、LSTMはより長い期間の情報を記憶することができる。そのため、過去のイベントが重要なシーケンスデータに特に適している。

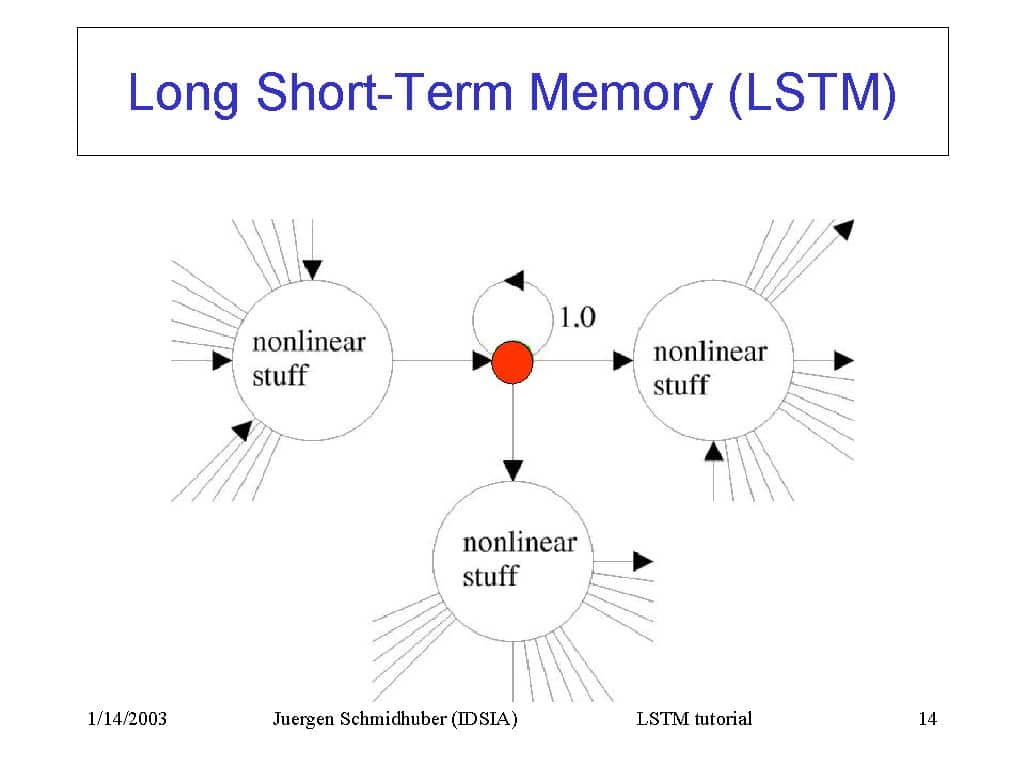

- LSTMモデルは、情報の流れを制御する様々な「ゲート」で構成されている。これらのゲートは、情報が忘れられたり、保存されたり、取り出されたりするタイミングを決定する。

- セルの状態はLSTMの核心である。これは一種のメモリとして機能し、長いシーケンスにわたって情報を保存する。

- 忘却ゲートはセル状態からどの情報を削除するかを決定する。シグモイド関数を使用し、どの値を破棄し、どの値をメモリに残すかを決定する

- セルの状態に関するどの新しい情報を追加するかを決定する。これは二つの部分から構成される: シグモイド活性化関数は更新する値を決定し、tanh 関数は新しい候補値を生成する。

LSTMの応用と利点

LSTMはシーケンスの長期的な依存関係を捉えることができる。そのため、LSTMの応用範囲は広い。

- LSTMモデルは、気象データや株価などのシーケンスを予測するのに優れている。LSTMは記憶力が高く、過去にさかのぼる情報を利用できるため、データ内の複雑な関係性を捉えることができる

- 自然言語処理では、LSTMはテキスト分類、名前付きエンティティ認識、機械翻訳などのタスクによく使用される。LSTMはテキストの文脈をより適切に捉えることができるため、翻訳結果の質を向上させることができる

- LSTMは音声認識にも使用でき、話し言葉をテキストに変換することができる。

- 長期的な依存関係を捉える能力により、LSTMは作曲のような時間的関係が重要なアプリケーションに最適です。